Dans Le Seigneur des Anneaux, les Palantíri sont des pierres de vision qui permettent à Sauron d’espionner chaque mouvement de ses ennemis. Un pouvoir absolu, mais corrupteur.

En 2003, Peter Thiel et Alex Karp nomment leur entreprise Palantir Technologies.

Vingt-trois ans plus tard, cette intuition se réalise : Palantir ne se contente pas de surveiller.

Elle prédit, corréle, décide. Leur manifeste The Technological Republic (2025) appelle à une Silicon Valley militarisée au service d’un « hard power » occidental basé sur l’IA.

Ma conviction ? Cette vision technocratique menace directement la liberté d’expression et les équilibres démocratiques.

Les Palantíri de Tolkien : une métaphore trop parfaite

Les Palantíri, créées par Fëanor au Premier Âge, sont sept pierres de vision reliées entre elles.

Elles permettent de voir à des milliers de lieues, de communiquer instantanément, d’espionner les pensées de celui qui les utilise. Denethor, intendant du Gondor, sombre dans la folie en contemplant trop longtemps l’œil de Sauron.

Pippin entrevoit l’armée de Sauron avant la bataille du Gondor. Gandalf prévient : « Même moi, Gandalf, je ne puis en contrôler totalement le pouvoir. »

Peter Thiel choisit ce nom en 2003 pour sa start-up avec Alex Karp, Joe Lonsdale, Stephen Cohen et Nathan Gettings.

La CIA investit immédiatement 2 millions de dollars via In-Q-Tel.

Au DailyMoogle, j’écris des articles pour vous accompagner partout : au bureau, dans les transports, ou chez vous tranquillement.

Abonnez-vous à ma newsletter et recevez directement dans votre boîte mail mes derniers articles, concours et petites surprises !

Le parallèle est limpide : comme les pierres de Tolkien, Palantir voit à travers les murs, connecte des données disparates, anticipe les comportements.

La différence essentielle ? Les Palantíri servaient Sauron.

Palantir travaille pour la CIA, le FBI, l’ICE, Interpol, la police britannique, l’armée ukrainienne et des gouvernements autoritaires.

Palantir en action : la technologie au service du contrôle

Ainsi Palantir n’est pas seulement un logiciel d’analyse de données.

C’est une manière d’ordonner le réel, de relier des fragments d’informations et de transformer des masses de données en décisions exploitables.

C’est précisément ce qui rend l’entreprise si puissante, mais aussi si inquiétante.

Derrière les promesses d’efficacité, de sécurité et d’optimisation, Palantir installe une logique simple : tout ce qui peut être relié peut être surveillé.

Et tout ce qui peut être surveillé peut, à terme, être anticipé, catégorisé, puis orienté.

C’est là que l’outil cesse d’être neutre.

Palantir : de l’analyse de données au pouvoir prédictif

Palantir ne vend pas de simples logiciels.

Elle vend une capacité de décision. Leur politique technologique s’articule autour de trois piliers :

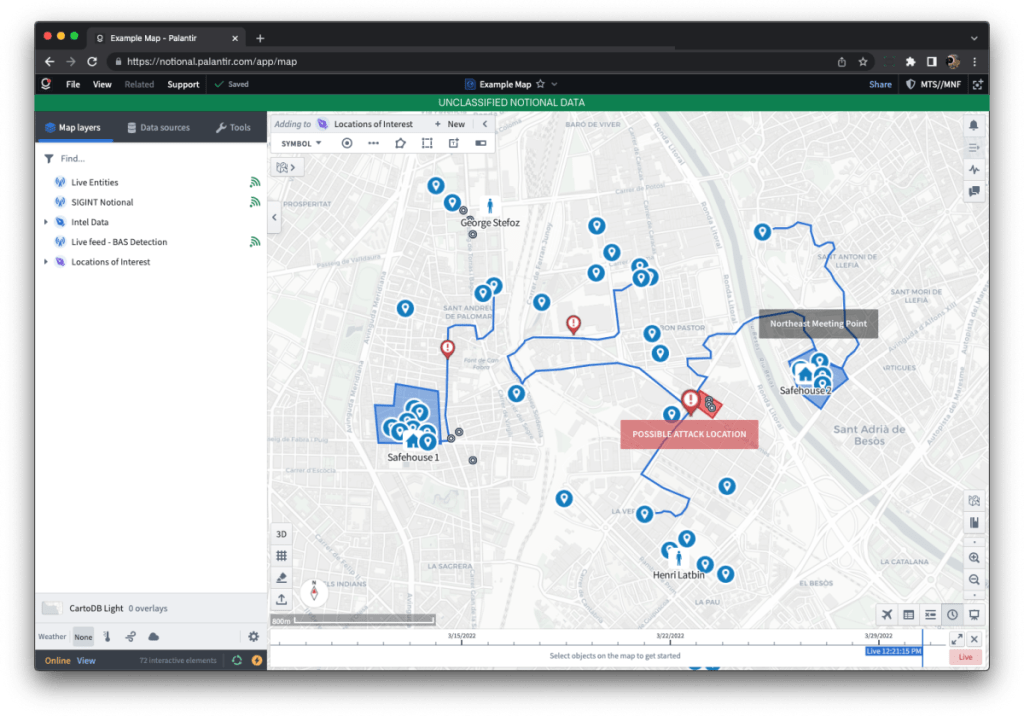

Palantir Gotham (2008) cible le renseignement.

Il corrèle métadonnées téléphoniques, transactions bancaires, vidéos de surveillance, posts sur réseaux sociaux, dossiers médicaux, géolocalisation.

En 2011, Gotham aide (selon certaines sources) à localiser Ben Laden. En 2014, la police de Los Angeles déploie Palantir pour la « predictive policing ».

Ce n’est pas encore Minority Report mais…

Palantir Foundry (2016) s’adresse aux entreprises.

Airbus optimise ses chaînes d’approvisionnement.

Merck prédit les ruptures de stock vaccinal.

En 2020, le NHS britannique signe malgré l’opposition de 32 parlementaires.

Palantir AIP (2023) intègre des LLMs (GPT-4, Llama) à Gotham.

Des « agents IA » autonomes décident en temps réel.

En 2025, l’Ukraine utilise Horus, système de ciblage IA russe (+40% précision frappes).

Chiffres 2026 : 120 milliards $ de capitalisation.

2,9 milliards $ de chiffre d’affaire en 2025 (+28%).

50% du CA gouvernemental.

4 000 employés.

Un logiciel qui voit trop bien

Palantir fonctionne comme une immense machine à relier les points. Une base de données judiciaire, un historique de déplacements, un dossier administratif, des échanges téléphoniques, des métadonnées, des images, des signaux faibles : tout cela peut être agrégé, recoupé et rendu lisible dans une interface pensée pour la décision rapide.

Sur le papier, l’idée semble presque rassurante.

Dans un monde saturé d’informations, aider les institutions à mieux comprendre les risques, les flux et les priorités peut paraître légitime. Mais le problème apparaît dès que l’outil devient structurel, c’est-à-dire quand il ne sert plus seulement à enquêter sur un cas précis, mais à cartographier des populations entières.

À ce moment-là, la frontière entre sécurité et surveillance devient floue.

Palantir ne se contente pas de montrer ce qui existe.

Il donne aussi à l’utilisateur le sentiment qu’il peut prévoir ce qui va arriver.

Et c’est cette bascule qui change tout.

Quand une technologie prétend anticiper les comportements, elle cesse d’être un simple support d’analyse.

Elle devient un instrument de pouvoir.

The Technological Republic : un manifeste technocratique

Le 11 avril 2025, Alex Karp et Nicholas Zamiska publient The Technological Republic (n°1 New York Times).

Et récemment sur Twitter, ils sont passé à l’étape supérieure avec ce thread.

De l’enquête à la suspicion

L’un des grands risques de ce type de technologie, c’est la transformation progressive du doute en méthode de gouvernance. Plus un système est capable de croiser des données, plus il devient tentant de l’utiliser pour repérer des “profils à risque”.

Le problème, c’est qu’un profil à risque n’est pas un fait.

C’est une construction.

Et puis cela peut toucher tout le monde, par rapport à votre sexe, âge, race, religion, opinions politiques ou même votre consommation d’essence, de viande ou de jeu vidéo qui sait !

À partir du moment où l’on s’appuie sur des corrélations pour orienter des décisions publiques, on entre dans une zone dangereuse.

Le système peut renforcer des biais déjà présents dans les institutions, parce qu’il apprend à partir de données produites par ces mêmes institutions.

Si certains groupes ont déjà été davantage contrôlés, arrêtés ou signalés, l’outil risque de reproduire cette asymétrie au lieu de la corriger.

C’est là que le contrôle devient systémique. Le logiciel ne se contente plus d’aider à voir. Il finit par aider à décider qui mérite d’être vu davantage. Et dans une démocratie, cette différence est fondamentale.

L’argument de l’efficacité

Les défenseurs de Palantir répondent souvent par une logique très simple : l’outil permet de gagner du temps, de sauver des vies et d’éviter le désordre.

Cet argument n’est pas absurde. Dans des contextes de guerre, de lutte antiterroriste ou de gestion de crise, mieux relier les informations peut réellement améliorer l’efficacité opérationnelle.

Mais l’efficacité n’est pas une valeur suffisante en soi.

Une technologie peut être redoutablement efficace tout en posant d’immenses problèmes politiques.

C’est exactement ce qui rend le débat autour de Palantir si difficile : on ne discute pas d’un outil manifestement inutile, mais d’un outil utile dans des cadres où l’urgence peut facilement écraser la réflexion.

Le danger n’est donc pas seulement ce que Palantir fait.

C’est ce qu’il rend acceptable. Quand une plateforme devient indispensable, elle cesse d’être discutée comme un choix.

Elle devient une évidence administrative. Et c’est souvent à ce moment-là que les garde-fous s’affaiblissent.

Le contrôle avant la transparence

Le cœur du problème, ce n’est pas seulement la collecte de données. C’est la manière dont elles sont interprétées, combinées et utilisées. Une technologie comme Palantir ne se contente pas d’empiler des informations. Elle construit une vision du monde.

Elle hiérarchise les signaux, sélectionne les anomalies et propose des lectures qui semblent objectives parce qu’elles sont chiffrées.

Mais une lecture chiffrée n’est pas une vérité neutre. Elle dépend du modèle, des paramètres, des données d’entrée et des choix humains qui l’alimentent. Or plus le système devient complexe, plus il devient difficile à contester. C’est là qu’il gagne en autorité.

Le risque est donc double : d’un côté, les institutions délèguent une partie de leur jugement à une plateforme ; de l’autre, les citoyens ne disposent pas des moyens réels pour comprendre pourquoi une décision a été prise. Quand une technologie devient trop opaque pour être discutée, elle commence à gouverner sans contrôle démocratique suffisant.

Une question de souveraineté

Palantir soulève aussi une question de souveraineté.

Quand un État ou une administration s’appuie durablement sur une plateforme privée pour traiter des informations sensibles, il devient dépendant d’une architecture qu’il ne maîtrise pas totalement.

Les données peuvent être hébergées localement, les contrats peuvent être encadrés, mais la logique d’ensemble reste celle d’un outil propriétaire, conçu et maintenu par une entreprise extérieure.

Cette dépendance technique peut sembler anodine au départ.

Elle ne l’est pas.

Car plus un système structure des fonctions régaliennes, plus il s’enracine dans l’État.

À partir de là, la question n’est plus seulement “qui possède les données ?”, mais “qui possède la capacité de les rendre intelligibles ?”.

C’est une différence décisive.

Celui qui maîtrise la lecture des données maîtrise aussi une part de l’action publique. Et si cette lecture est confiée à une entreprise privée, la frontière entre service, influence et pouvoir devient extrêmement fragile.

Le glissement autoritaire

Avec Assange et Snowden, on a compris que la surveillance de masse n’était pas une théorie paranoïaque ; avec Palantir, elle devient une infrastructure.

C’est pour cela que Palantir inquiète autant. Pas parce qu’il serait, en soi, une machine à dictature. Mais parce qu’il peut devenir l’infrastructure discrète d’un contrôle normalisé. Une technologie n’a pas besoin d’être brutale pour produire des effets autoritaires. Il suffit qu’elle soit intégrée partout, jugée indispensable, et acceptée au nom de la sécurité.

Le glissement se fait alors en douceur.

On commence par une mission précise : la lutte antiterroriste, la gestion de crise, l’optimisation logistique.

Puis viennent d’autres usages, d’autres services, d’autres contextes. Petit à petit, l’exception devient méthode.

Et ce qui était censé protéger l’État finit par renforcer sa capacité à observer, classer et orienter les comportements.

C’est là que l’alerte doit être posée clairement : quand la surveillance devient une infrastructure, la liberté devient conditionnelle.

Le vrai sujet : qui contrôle le contrôleur ?

La question centrale n’est donc pas seulement “Palantir est-il utile ?”.

La vraie question est : qui contrôle un système capable de voir autant ?

Car une société qui accepte qu’un acteur privé croise des données sensibles à grande échelle accepte aussi, implicitement, de déplacer une partie du pouvoir vers ce même acteur.

Ce déplacement peut rester invisible pendant longtemps.

C’est même ce qui le rend dangereux. Il ne prend pas la forme d’un coup d’État. Il prend la forme d’un contrat.

Et lorsqu’un contrat devient l’architecture ordinaire de la sécurité, il est déjà trop tard pour prétendre que la question était purement technique.

Conclusion

Palantir n’est pas seulement un outil de « data analysis ».

C’est une technologie de mise en ordre du monde.

Et plus elle devient centrale, plus elle oblige à poser des questions politiques, juridiques et démocratiques.

Son efficacité n’efface pas ses risques.

Son utilité ne doit pas faire oublier sa puissance. Et sa puissance ne doit jamais être confondue avec sa légitimité.

La vraie ligne de fracture n’est pas entre les partisans et les opposants à la technologie.

Elle est entre ceux qui acceptent qu’un outil aussi puissant reste lisible, contestable et borné, et ceux qui préfèrent laisser la surveillance devenir une évidence silencieuse.

Laisser un commentaire